Comparison Shortlist

Maschinenbereite Briefings: KI macht aus unklaren Bedürfnissen eine technische Projektanfrage.

Wir verwenden Cookies, um Ihre Erfahrung zu verbessern und den Website-Traffic zu analysieren. Sie können alle Cookies akzeptieren oder nur die notwendigen.

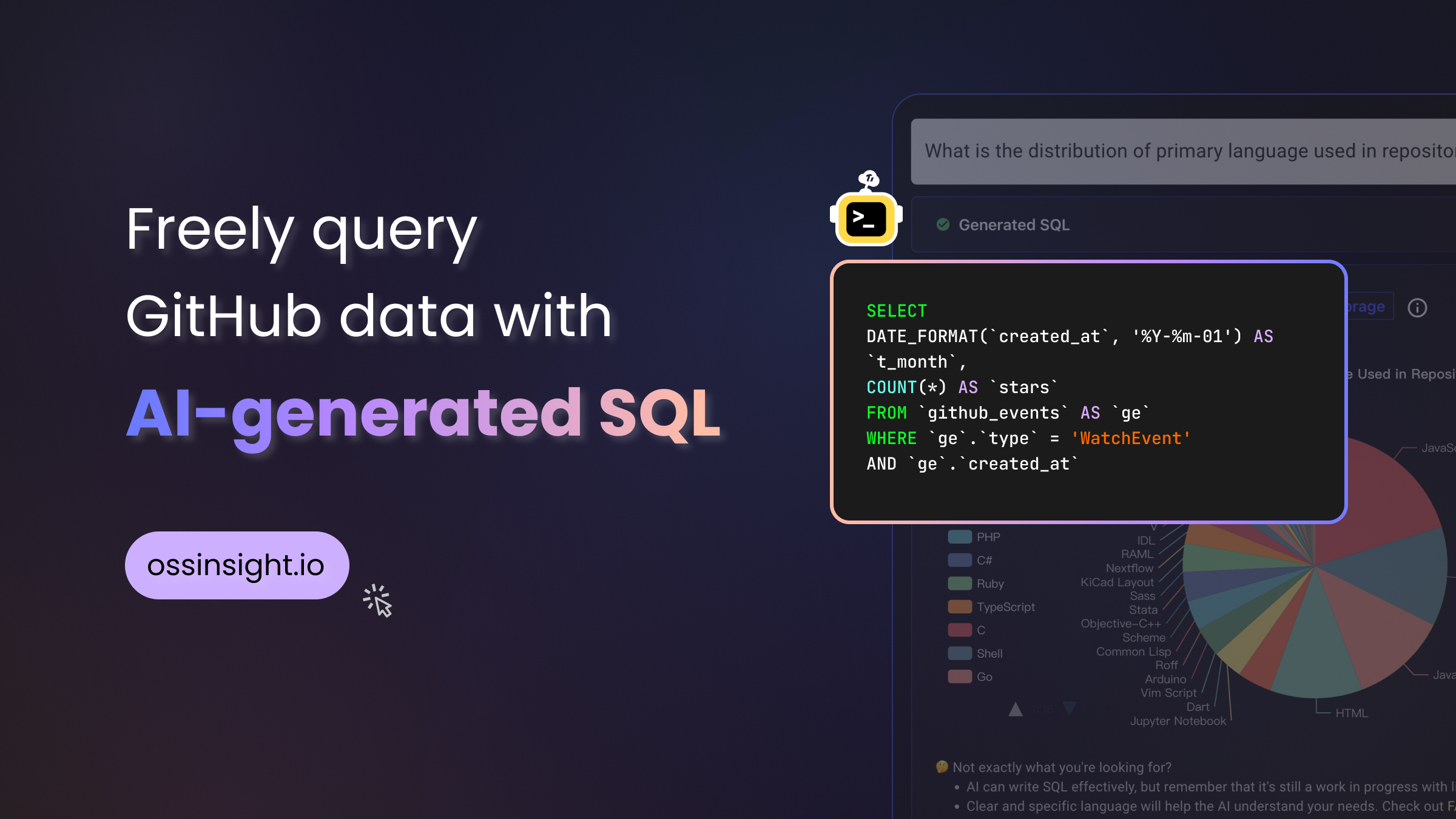

Durchsuchen Sie keine statischen Listen mehr. Teilen Sie Bilarna Ihre konkreten Anforderungen mit. Unsere KI übersetzt Ihre Worte in eine strukturierte, maschinenbereite Anfrage und leitet sie sofort an verifizierte Datenwissenschaft & Analyse-Expert:innen weiter – für präzise Angebote.

Maschinenbereite Briefings: KI macht aus unklaren Bedürfnissen eine technische Projektanfrage.

Verifizierte Trust-Scores: Vergleichen Sie Anbieter mit unserem 57-Punkte-KI-Sicherheitscheck.

Direkter Zugang: Überspringen Sie kalte Akquise. Fordern Sie Angebote an und buchen Sie Demos direkt im Chat.

Präzises Matching: Filtern Sie nach konkreten Rahmenbedingungen, Budget und Integrationen.

Risikominimierung: Validierte Kapazitätssignale reduzieren Prüfaufwand & Risiko.

Gerankt nach KI-Trust-Score & Leistungsfähigkeit

Führen Sie einen kostenlosen AEO- und Signal-Audit für Ihre Domain durch.

Answer-Engine-Optimierung (AEO)

List once. Convert intent from live AI conversations without heavy integration.

Datenwissenschaft und Analyse ist ein interdisziplinäres Feld, das wissenschaftliche Methoden, Algorithmen und Systeme nutzt, um Wissen und Erkenntnisse aus strukturierten und unstrukturierten Daten zu gewinnen. Es kombiniert Statistik, maschinelles Lernen, Data Mining und Datenvisualisierung, um komplexe Geschäftsprobleme in Branchen wie Finanzen, Gesundheitswesen, Einzelhandel und Fertigung zu lösen. Das Kernziel ist die Transformation von Rohdaten in umsetzbare Intelligenz, die prädiktive Modellierung, Prozessoptimierung und datengestützte Entscheidungsfindung ermöglicht. Diese Disziplin hilft Organisationen, Trends zu identifizieren, Ergebnisse vorherzusagen und verborgene Chancen aufzudecken, um Innovation und Wettbewerbsvorteile zu fördern.

Dienstleistungen für Datenwissenschaft und Analyse werden von spezialisierten Beratungsunternehmen, Boutique-Analyseagenturen und großen Enterprise-Softwareanbietern angeboten. Anbieter beschäftigen typischerweise Teams aus Data Scientists, Statistikern, Machine-Learning-Ingenieuren und Business-Intelligence-Analysten, von denen viele über fortgeschrittene Abschlüsse oder Zertifizierungen in Bereichen wie Informatik, Statistik oder Operations Research verfügen. Führende Anbieter können auch Partnerschaften mit Cloud-Plattformen wie AWS, Google Cloud oder Microsoft Azure unterhalten und branchenspezifische Qualifikationen besitzen. Unabhängige Berater und Nischenfirmen konzentrieren sich oft auf vertikale Bereiche wie Marketinganalyse, Finanzrisikomodellierung oder Supply-Chain-Optimierung.

Der typische Datenwissenschafts-Workflow beginnt mit der Problemdefinition und Datenerfassung, gefolgt von Datenbereinigung, explorativer Analyse und Feature-Engineering. Anschließend erstellen Analysten prädiktive Modelle mit Machine-Learning-Bibliotheken und validieren diese, bevor sie in Produktionsumgebungen bereitgestellt werden. Gängige Preismodelle umfassen projektbasierte Gebühren für einmalige Initiativen, monatliche Pauschalbeträge für laufende Unterstützung und abonnementbasierter Zugang zu Analyseplattformen oder SaaS-Tools. Implementierungszeiträume reichen von wenigen Wochen für einen Proof-of-Concept bis zu mehreren Monaten für unternehmensweite Einführungen. Viele Anbieter bieten heute digitale Onboarding-Prozesse mit Online-Angeboten, sicheren Daten-Upload-Portalen und iterativen Feedback-Schleifen für eine effiziente Zusammenarbeit.

Datenanalyse und Erkenntnisse verwandeln Rohdaten in umsetzbare Geschäftsinformationen. Vergleichen und vernetzen Sie sich mit geprüften Anbietern auf Bilarnas KI-gestütztem Marktplatz.

View Datenanalyse & Erkenntnisse providersZu den Hauptmerkmalen, auf die man bei einem PR-Analyse- und Messwerkzeug achten sollte, gehören umfassende Datenaggregation, umsetzbare Leistungskennzahlen und anpassbare Berichterstattung. Ein effektives Werkzeug sollte die Berichterstattung aus globalen Nachrichten, Online-Medien und sozialen Plattformen in einem einzigen Dashboard konsolidieren. Wesentliche zu messende Metriken sind die Markenbekanntheit im Vergleich zu Wettbewerbern, die Engagement-Raten des Publikums, die Sentiment-Analyse (positiv, negativ, neutral), die geschätzte Reichweite oder Impressionen sowie der Verweisverkehr auf die Website oder die SEO-Wirkung. Fortgeschrittene Werkzeuge bieten Attributionsfähigkeiten, die Medienberichterstattung mit spezifischen Geschäftsergebnissen wie Lead-Generierung oder Einfluss auf die Verkaufspipeline über integrierte Webanalyse verknüpfen. Die Fähigkeit, automatisierte, präsentationsfertige Berichte für Stakeholder zu erstellen, ist entscheidend, um den Wert zu demonstrieren. Darüber hinaus bietet die Integration mit anderen Marketing- und CRM-Systemen eine ganzheitliche Sicht auf die Kommunikationsleistung und ermöglicht datengesteuerte Strategieanpassungen und eine klare Rechtfertigung der PR-Ausgaben.

KI-gesteuerte Analyse unterstützt Private-Equity-Firmen dabei, bessere Investitionsentscheidungen zu treffen, indem sie komplexe und unstrukturierte Deal-Daten schnell in klare, umsetzbare Erkenntnisse verwandelt. Sie automatisiert arbeitsintensive Aufgaben wie Datenerfassung, Berechnung wichtiger Finanzkennzahlen und Identifikation von Wachstumstreibern oder Risiken. Dadurch können Analysten die Geschäftsgesundheit genauer und effizienter bewerten und das Risiko von Übersehenem reduzieren. Durch die Verarbeitung von mehr Deals in kürzerer Zeit können Firmen mehr Chancen nutzen und schneller auf Marktveränderungen reagieren. Zudem stellen KI-Tools, die auf Private-Equity-Workflows abgestimmt sind, sicher, dass die Erkenntnisse relevant und vertrauenswürdig sind, was eine sichere und präzisere Entscheidungsfindung auf Führungsebene unterstützt.

KI kann bei der Analyse von Tabellendaten helfen, indem sie Muster, Trends und Anomalien erkennt, die für Nutzer nicht sofort ersichtlich sind. Sie kann Zusammenfassungen erstellen, statistische Analysen durchführen und Visualisierungen bereitstellen, um komplexe Datensätze besser zu interpretieren. KI-gestützte Werkzeuge können zudem umsetzbare Erkenntnisse vorschlagen und zukünftige Ergebnisse basierend auf historischen Daten vorhersagen. Dies ermöglicht Nutzern, datenbasierte Entscheidungen effizienter und mit größerem Vertrauen zu treffen, was die Produktivität und Genauigkeit insgesamt steigert.

Serienhersteller können automatisierte Soll-Kosten-Analyse nutzen, um effizient eine große Anzahl von Kostenvoranschlägen pro Monat zu erstellen. Durch die Automatisierung des Kostenschätzungsprozesses reduzieren sie den Zeit- und Arbeitsaufwand für die Erstellung genauer Angebote für mehrere Chargen oder Produktvarianten. Diese Automatisierung verbessert die Konsistenz und Genauigkeit der Angebote, minimiert menschliche Fehler und ermöglicht es den Herstellern, schneller auf Kundenanfragen zu reagieren. Letztlich unterstützt sie die Skalierbarkeit der Produktion und steigert die Wettbewerbsfähigkeit, indem Serienhersteller hohe Angebotsanforderungen bewältigen können, ohne die Qualität zu beeinträchtigen.

Die Nachtdream-Analyse basiert auf der Jung'schen Psychologie und der prozessorientierten Traumarbeitsmethodik. Befolgen Sie diese Schritte, um den Ansatz zu verstehen: 1. Erkennen Sie, dass die Jung'sche Psychologie Symbole, Archetypen und das Unbewusste in der Traumdeutung betont. 2. Verstehen Sie, dass die prozessorientierte Traumarbeit sich auf die sich entfaltende Erfahrung im Traum und deren Verbindung zum Wachleben konzentriert. 3. Die Analyse integriert diese Rahmenwerke, um eine strukturierte Reflexion zu bieten, die Ihre täglichen Erfahrungen mit Traum-Einsichten verbindet. 4. Nutzen Sie diesen kombinierten Ansatz, um durch Ihre Träume tiefere Selbstwahrnehmung und emotionale Verarbeitung zu erlangen.

Ja, KMUs können von einem kostenlosen Erstoptimierungsangebot profitieren, indem sie: 1. Sich für den KI-Business-Analyse-Service anmelden. 2. Notwendige Geschäftsdaten für die Erstbewertung bereitstellen. 3. Einen kostenlosen Bericht mit konkreten Verbesserungsvorschlägen erhalten. 4. Basierend auf den Ergebnissen der kostenlosen Analyse weitere Schritte entscheiden. So können KMUs die Vorteile von KI ohne Vorabkosten bewerten.

Entwickeln Sie fehlende Funktionen oder Integrationen, indem Sie diese Schritte befolgen: 1. Beteiligen Sie sich am Open-Source-Projekt durch Code- oder Ideeneinreichungen. 2. Kontaktieren Sie das Team per E-Mail, Telegram oder Twitter, um Ihre Funktion oder Integration zu besprechen. 3. Erhalten Sie Unterstützung während der Entwicklung und mögliche Belohnungen, wenn die Funktion weit verbreitet angenommen wird.

Ja, mehrere Social-Media-Plattformen können gleichzeitig analysiert werden. 1. Verbinden Sie das Tool mit wichtigen Plattformen wie Twitter, Instagram, Facebook und LinkedIn. 2. Verwenden Sie ein einziges Dashboard, um Sentiment-Daten über alle verbundenen Plattformen hinweg anzuzeigen. 3. Diese einheitliche Ansicht bietet ein umfassendes Verständnis der Social-Media-Präsenz Ihrer Marke.

Automatische Datenerfassung ist entscheidend, da sie sicherstellt, dass jede Nutzerinteraktion auf allen digitalen Plattformen ohne manuellen Aufwand oder technische Ressourcen erfasst wird. Dies führt zu einem vollständigen und genauen Datensatz, der die tatsächliche Customer Journey widerspiegelt. Mit umfassenden Daten können Unternehmen Verhaltensweisen analysieren, Konversionshindernisse identifizieren und Verbesserungsmöglichkeiten entdecken. Es beseitigt blinde Flecken, die durch unvollständiges Tracking entstehen, und ermöglicht schnellere, datenbasierte Entscheidungen. Letztendlich bildet die automatische Datenerfassung die Grundlage für eine effektive Optimierung der digitalen Erfahrung und ein besseres Kundenverständnis.

KI-gestützte Analyse ist wichtig zur Verbesserung der Kundenzufriedenheit, da sie Unternehmen ermöglicht, Kundenprobleme schnell und genau zu verstehen. 1. Sie verarbeitet große Mengen an Feedback effizient und entdeckt verborgene Muster. 2. Sie identifiziert Ursachen von Unzufriedenheit, die manuelle Analysen übersehen könnten. 3. Sie liefert datenbasierte Erkenntnisse zur Priorisierung von Verbesserungen. 4. Sie hilft, Lösungen auf spezifische Kundenbedürfnisse zuzuschneiden. 5. Sie unterstützt die kontinuierliche Überwachung zur Anpassung von Strategien und zur Aufrechterhaltung hoher Zufriedenheitswerte.