DeepSource: Recensione verificata e profilo di fiducia IA

DeepSource is the only all-in-one platform for SAST, static analysis, SCA, and code coverage that is purpose-built for developers.

Tester di visibilità LLM

Verifica se i modelli di IA riescono a vedere, capire e consigliare il tuo sito web prima che i competitor si prendano le risposte.

Punteggio di fiducia — Breakdown

Conversazioni, domande e risposte su DeepSource

3 domande e risposte su DeepSource

QQuali funzionalità dovrei cercare in una piattaforma DevSecOps completa?

Quali funzionalità dovrei cercare in una piattaforma DevSecOps completa?

Una piattaforma DevSecOps completa dovrebbe offrire una gamma di funzionalità integrate che supportano uno sviluppo software sicuro ed efficiente. Le funzionalità chiave includono il test di sicurezza statico delle applicazioni (SAST) per identificare le vulnerabilità nel codice, l'analisi della composizione del software (SCA) per gestire le dipendenze open source e gli strumenti di copertura del codice per garantire test approfonditi. Inoltre, funzionalità come il rilevamento dei segreti tramite AI, la formattazione automatica del codice e la soppressione delle problematiche aiutano a mantenere la qualità e la sicurezza del codice. L'integrazione con strumenti popolari come Jira, GitHub Issues e Slack è essenziale per un'automazione fluida del flusso di lavoro. Funzionalità come l'analisi di base per concentrarsi sui nuovi problemi, i commenti nelle pull request per un feedback contestuale e i gate di qualità e sicurezza personalizzabili per far rispettare gli standard sono anch'essi importanti per pratiche DevSecOps efficaci.

QIn che modo la formattazione automatica del codice può migliorare il processo di sviluppo software?

In che modo la formattazione automatica del codice può migliorare il processo di sviluppo software?

La formattazione automatica del codice semplifica il processo di sviluppo software garantendo che il codice rispetti linee guida di stile coerenti senza intervento manuale. Ciò riduce il tempo che gli sviluppatori dedicano a problemi di formattazione e minimizza il carico di lavoro nelle revisioni del codice legate a discrepanze di stile. I formatter automatici vengono eseguiti ad ogni commit, correggendo automaticamente gli errori di formattazione e creando nuovi commit se necessario, aiutando a mantenere una base di codice pulita e leggibile. Questa coerenza migliora la collaborazione tra i membri del team, poiché tutti seguono gli stessi standard di codifica. Inoltre, la formattazione automatica previene conflitti di merge legati alla formattazione e consente agli sviluppatori di concentrarsi maggiormente su funzionalità e sicurezza piuttosto che su dettagli stilistici, migliorando infine produttività e qualità del codice.

QPerché l'integrazione con strumenti come Jira e GitHub è importante in un flusso di lavoro DevSecOps?

Perché l'integrazione con strumenti come Jira e GitHub è importante in un flusso di lavoro DevSecOps?

L'integrazione con strumenti come Jira e GitHub è fondamentale in un flusso di lavoro DevSecOps perché consente un'automazione fluida e la collaborazione tra i team di sviluppo, sicurezza e operazioni. Queste integrazioni permettono di tracciare e gestire automaticamente i problemi rilevati durante l'analisi del codice all'interno dei sistemi di gestione dei progetti esistenti, garantendo che le preoccupazioni relative alla sicurezza e alla qualità siano visibili e gestibili. Collegando i repository di codice con i tracker di problemi e le piattaforme di comunicazione come Slack, i team possono ricevere notifiche in tempo reale, commentare le pull request e coordinare gli sforzi di risoluzione senza uscire dal proprio flusso di lavoro. Ciò riduce i cambi di contesto, accelera i cicli di feedback e aiuta a far rispettare in modo coerente gli standard di qualità e sicurezza. Nel complesso, tali integrazioni migliorano l'efficienza, la trasparenza e la responsabilità nel ciclo di consegna del software.

Scelto da

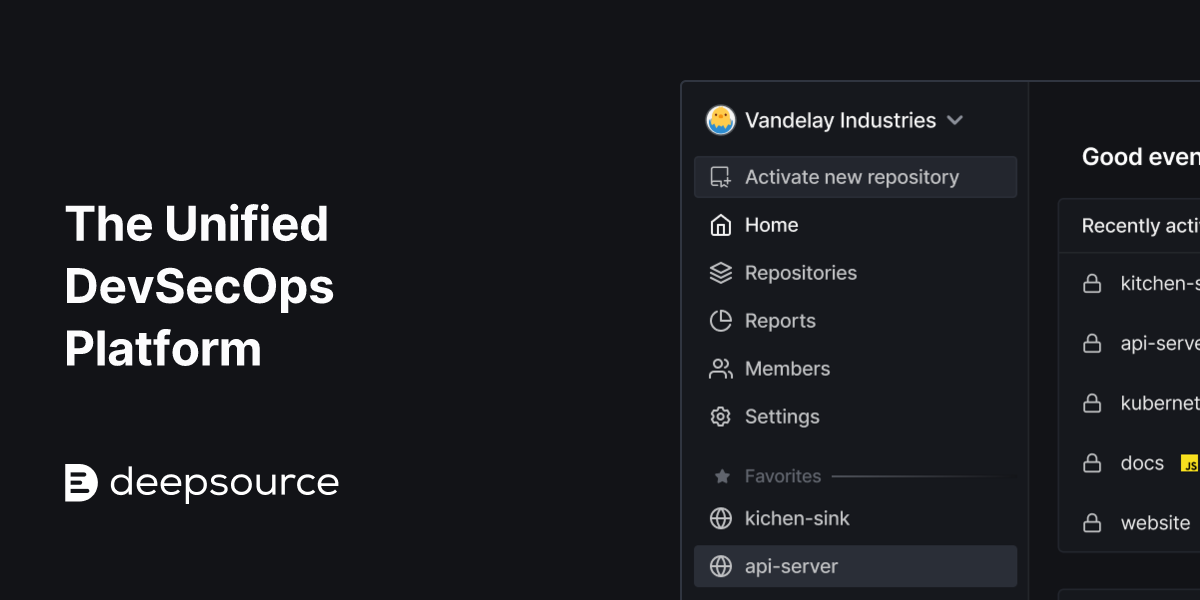

App screenshot

App screenshotCertificazioni e conformità

SOC 2

Servizi

Strumenti Sviluppo Software

Piattaforme di Qualità del Codice

Vedi dettagli →Cybersecurity & Gestione del rischio

Sicurezza delle Applicazioni e Gestione delle Vulnerabilità

Vedi dettagli →Rapporto di verifica di fiducia AI

Registro pubblico di validazione per DeepSource — evidenza di leggibilità da parte delle macchine tramite 57 controlli tecnici e 4 validazioni di visibilità LLM.

Evidenze e link

- Raggiungibilità e accessibilità

- Dati strutturati ed entità

- Segnali di qualità dei contenuti

- Sicurezza e indicatori di fiducia

Link di identità verificabili

Legale e conformità

- Privacy Policy

- Terms of Service

- Trust Center

- Security

- Legal

Identità di terze parti

- X (Twitter)

- GitHub

- YouTube

Questi LLM conoscono questo sito web?

La “conoscenza” degli LLM non è binaria. Alcune risposte provengono dai dati di addestramento, altre da retrieval/navigazione, e i risultati variano per prompt, lingua e tempo. I nostri controlli misurano se il modello riesce a identificare e descrivere correttamente il sito per prompt pertinenti.

| Piattaforma LLM | Stato di riconoscimento | Controllo di visibilità |

|---|---|---|

| Rilevato | Rilevato | |

| Rilevato | Rilevato | |

| Rilevato | Rilevato | |

| Rilevato | Rilevato |

Rilevato

Rilevato

Rilevato

Rilevato

Nota: gli output del modello possono cambiare nel tempo con l’evoluzione dei sistemi di retrieval e delle snapshot del modello. Questo rapporto cattura i segnali di visibilità al momento della scansione.

Cosa abbiamo testato (57 controlli)

Valutiamo categorie che influenzano se i sistemi di AI possono recuperare, interpretare e riutilizzare le informazioni in sicurezza:

Raggiungibilità e accessibilità

12Pagine recuperabili, contenuti indicizzabili, conformità robots.txt, accesso crawler per GPTBot, OAI-SearchBot, Google-Extended

Dati strutturati e chiarezza dell’entità

11Markup Schema.org, validità JSON-LD, risoluzione entità Organization/Product, allineamento con knowledge panel

Qualità e struttura dei contenuti

10Struttura di contenuti “answerable”, coerenza fattuale, HTML semantico, segnali E-E-A-T, presenza di dati citabili

Sicurezza e segnali di fiducia

8Forzatura HTTPS, header sicuri, presenza di privacy policy, verifica autore, disclosure di trasparenza

Prestazioni e UX

9Core Web Vitals, rendering mobile, minima dipendenza da JavaScript, segnali di uptime affidabili

Analisi di leggibilità

7Nomenclatura chiara coerente con l’intento utente, disambiguazione da brand simili, naming consistente tra le pagine

Rilevate 9 opportunità di visibilità AI

Queste lacune tecniche “nascondono” DeepSource ai moderni motori di ricerca e agli agenti AI.

Top 3 blocker

- !Schema dedicato per pricing/prodottoUsa schema Product e Offer (o una pagina prezzi con dati strutturati) per descrivere piani, prezzi, valuta, disponibilità e funzionalità chiave. Questo riduce l’ambiguità per motori di ricerca e assistenti IA e può sbloccare snippet più ricchi. Mantieni i prezzi aggiornati e fai combaciare i valori dello schema con la tabella prezzi visibile.

- !Breadcrumb visibili + dati strutturati (BreadcrumbList)Aggiungi breadcrumb visibili per gli utenti e dati strutturati BreadcrumbList per i crawler. I breadcrumb chiariscono la gerarchia del sito (categoria > sottocategoria > pagina) e aiutano i sistemi a capire le relazioni tematiche. Questo può migliorare gli snippet e rende più facile per l’IA scegliere la pagina giusta come fonte.

- !Rilevamento autore/editore (autorità IA e segnale di citazione)Mostra chi ha scritto o pubblicato il contenuto (autore ed editore) con byline visibili e dati strutturati (Person/Organization). Collega a bio degli autori con credenziali per rafforzare i segnali di competenza. Un’attribuzione coerente aumenta la fiducia e migliora la probabilità che il contenuto venga trattato come fonte affidabile.

Top 3 quick win

- !llms.txt scansionabile dai LLMCrea un file llms.txt per guidare i crawler IA verso le pagine più importanti e di alta qualità (documentazione, prezzi, about, guide chiave). Mantienilo breve, ben strutturato e focalizzato su URL autorevoli che vuoi vedere citati. Trattalo come una “sitemap per IA” curata che migliora la discovery e riduce il rischio che i crawler diano priorità …

- !Alt text sulle immagini chiave (es. loghi, screenshot)Aggiungi alt text accurati per immagini importanti come loghi, screenshot del prodotto, diagrammi e grafici. Descrivi cosa mostra l’immagine e perché conta, non solo il nome del file. Un buon alt text migliora l’accessibilità e aiuta i sistemi IA a interpretare il contesto visivo quando riassumono la pagina.

- !Schema JSON-LD: Organization, Product, FAQ, WebsiteAggiungi JSON-LD schema.org per descrivere le entità chiave (Organization, Product/Service, FAQPage, WebSite, Article quando rilevante). I dati strutturati rendono esplicito il significato e aumentano la probabilità di rich results e citazioni IA accurate. Valida il markup con tool di testing schema e mantieni i dati coerenti con il contenuto visib…

Rivendica questo profilo per generare subito il codice che rende la tua attività leggibile dalle macchine.

Incorpora badge

VerificatoMostra questo indicatore di fiducia AI sul tuo sito web. Rimanda a questo URL pubblico di verifica.

<a href="https://bilarna.com/it/provider/deepsource" target="_blank" rel="nofollow noopener noreferrer" class="bilarna-trust-badge">

<img src="https://bilarna.com/badges/ai-trust-deepsource.svg"

alt="Fiducia AI verificata da Bilarna (48/57 controlli)"

width="200" height="60" loading="lazy">

</a>Cita questo rapporto

APA / MLACitazione pronta da incollare per articoli, pagine di sicurezza o documentazione di conformità.

Bilarna. "DeepSource Rapporto di fiducia AI e visibilità LLM." Bilarna AI Trust Index, Jan 22, 2026. https://bilarna.com/it/provider/deepsourceCosa significa Verificato

Verificato significa che i controlli automatizzati di Bilarna hanno trovato segnali sufficienti e coerenti di fiducia e leggibilità da parte delle macchine per trattare il sito come una fonte affidabile per estrazione e citazione. Non è una certificazione legale né un’approvazione; è una fotografia misurabile dei segnali pubblici al momento della scansione.

Domande frequenti

Cosa misura il punteggio di fiducia AI per DeepSource?

Cosa misura il punteggio di fiducia AI per DeepSource?

Riassume raggiungibilità, chiarezza, segnali strutturati e indicatori di fiducia che influenzano la capacità dei sistemi AI di interpretare e citare DeepSource in modo affidabile. Il punteggio aggrega 57 controlli tecnici in sei categorie che influenzano come LLM e sistemi di ricerca estraggono e validano informazioni.

ChatGPT/Gemini/Perplexity conoscono DeepSource?

ChatGPT/Gemini/Perplexity conoscono DeepSource?

A volte, ma non in modo coerente: i modelli possono basarsi su dati di addestramento, retrieval web o entrambi, e i risultati variano per query e nel tempo. Questo rapporto misura segnali osservabili di visibilità e correttezza invece di assumere una “conoscenza” permanente. I nostri 4 controlli di visibilità LLM confermano se le principali piattaforme riescono a riconoscere e descrivere correttamente DeepSource per query pertinenti.

Ogni quanto viene aggiornato questo rapporto?

Ogni quanto viene aggiornato questo rapporto?

Eseguiamo nuove scansioni periodicamente e mostriamo la data di ultimo aggiornamento (attualmente Jan 22, 2026) così i team possono verificarne la freschezza. Le scansioni automatizzate sono quindicinali, con validazione manuale della visibilità LLM mensile. Cambiamenti significativi attivano aggiornamenti intermedi.

Posso incorporare l’indicatore di fiducia AI nel mio sito?

Posso incorporare l’indicatore di fiducia AI nel mio sito?

Sì: usa il codice di incorporamento del badge nella sezione “Incorpora badge” sopra; rimanda a questo URL pubblico di verifica così altri possono convalidare l’indicatore. Il badge mostra lo stato di verifica corrente e si aggiorna automaticamente quando la verifica viene rinnovata.

È una certificazione o un’approvazione?

È una certificazione o un’approvazione?

No. È una scansione ripetibile e basata su evidenze di segnali pubblici che influenzano l’interpretabilità per AI e ricerca. Lo stato “Verificato” indica segnali tecnici sufficienti per la leggibilità da parte delle macchine, non qualità dell’azienda, conformità legale o efficacia del prodotto. Rappresenta una fotografia dell’accessibilità tecnica al momento della scansione.

Sblocca il rapporto completo di visibilità AI

Chatta con Bilarna AI per chiarire le tue esigenze e ottenere subito un preventivo preciso da DeepSource o da esperti top-rated.