SafetyKit: Reseña verificada y perfil de confianza de IA

Deploy AI agents to automate risk reviews, onboarding, and investigations. Trusted by leading marketplaces and fintech platforms.

Probador de visibilidad LLM

Comprueba si los modelos de IA pueden ver, entender y recomendar tu sitio web antes de que los competidores se adueñen de las respuestas.

Puntuación de confianza — Breakdown

Conversaciones, preguntas y respuestas sobre SafetyKit

3 preguntas y respuestas sobre SafetyKit

Q¿Cómo pueden los agentes de IA ayudar a automatizar las revisiones de riesgos y la detección de fraudes en los mercados en línea?

¿Cómo pueden los agentes de IA ayudar a automatizar las revisiones de riesgos y la detección de fraudes en los mercados en línea?

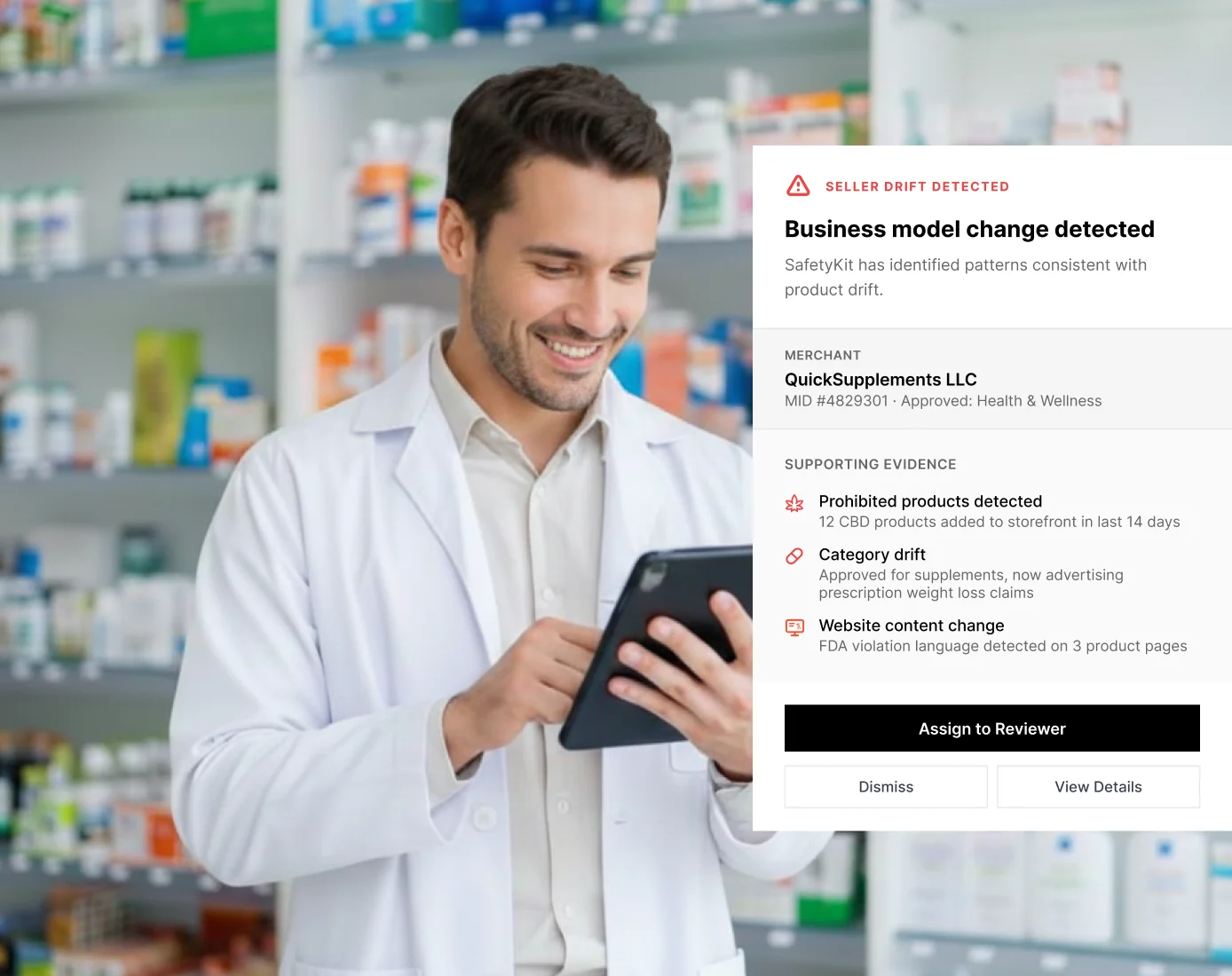

Los agentes de IA pueden automatizar las revisiones de riesgos y la detección de fraudes en los mercados en línea utilizando aprendizaje automático en tiempo real e IA agentiva para analizar transacciones, comportamiento de usuarios y contenido. Estos sistemas identifican proactivamente actividades sospechosas, reducen los falsos positivos y aceleran los procesos de toma de decisiones. Al integrar la inteligencia humana con la IA, las plataformas pueden mitigar eficazmente riesgos como fraude, abuso y spam, mejorando la seguridad general y la eficiencia operativa. Esta automatización también ayuda a reducir costos y mejora la calidad de la experiencia del mercado para compradores y vendedores.

Q¿Cuáles son los beneficios de usar IA para la moderación de contenido en mercados digitales?

¿Cuáles son los beneficios de usar IA para la moderación de contenido en mercados digitales?

El uso de IA para la moderación de contenido en mercados digitales ofrece varios beneficios, incluida la capacidad de hacer cumplir de manera eficiente cientos de áreas políticas y procedimientos operativos estándar personalizados. Los modelos de IA pueden analizar rápidamente grandes cantidades de listados y contenido generado por usuarios para detectar violaciones como spam, acoso, productos falsificados y medios inapropiados. Esto conduce a tiempos de implementación más rápidos, mayores tasas de precisión y una aplicación coherente de las políticas. Además, la moderación impulsada por IA reduce la carga de trabajo de los equipos humanos, permitiéndoles centrarse en casos complejos mientras mantienen un entorno seguro y confiable para los usuarios.

Q¿Cómo mejora la gestión de casos nativa de IA los flujos de trabajo de investigación en la detección de fraudes?

¿Cómo mejora la gestión de casos nativa de IA los flujos de trabajo de investigación en la detección de fraudes?

La gestión de casos nativa de IA mejora los flujos de trabajo de investigación en la detección de fraudes al automatizar la clasificación, investigación y escalada de casos. Los flujos de trabajo de IA agentiva priorizan y manejan tareas rutinarias, permitiendo que los investigadores humanos se enfoquen en casos de alto impacto y complejos. Esta automatización acelera el proceso de investigación, aumenta la precisión y asegura una supervisión continua las 24 horas. Al integrar la IA con la experiencia humana, las plataformas pueden profundizar de manera más eficiente en las actividades de comerciantes, listados y redes, lo que resulta en acciones más rápidas contra actores maliciosos coordinados y una mejor mitigación general del riesgo.

De confianza para

EtsyCliente clave

EtsyCliente clave_logo%201.png) LimeCliente clave

LimeCliente clave UpworkCliente clave

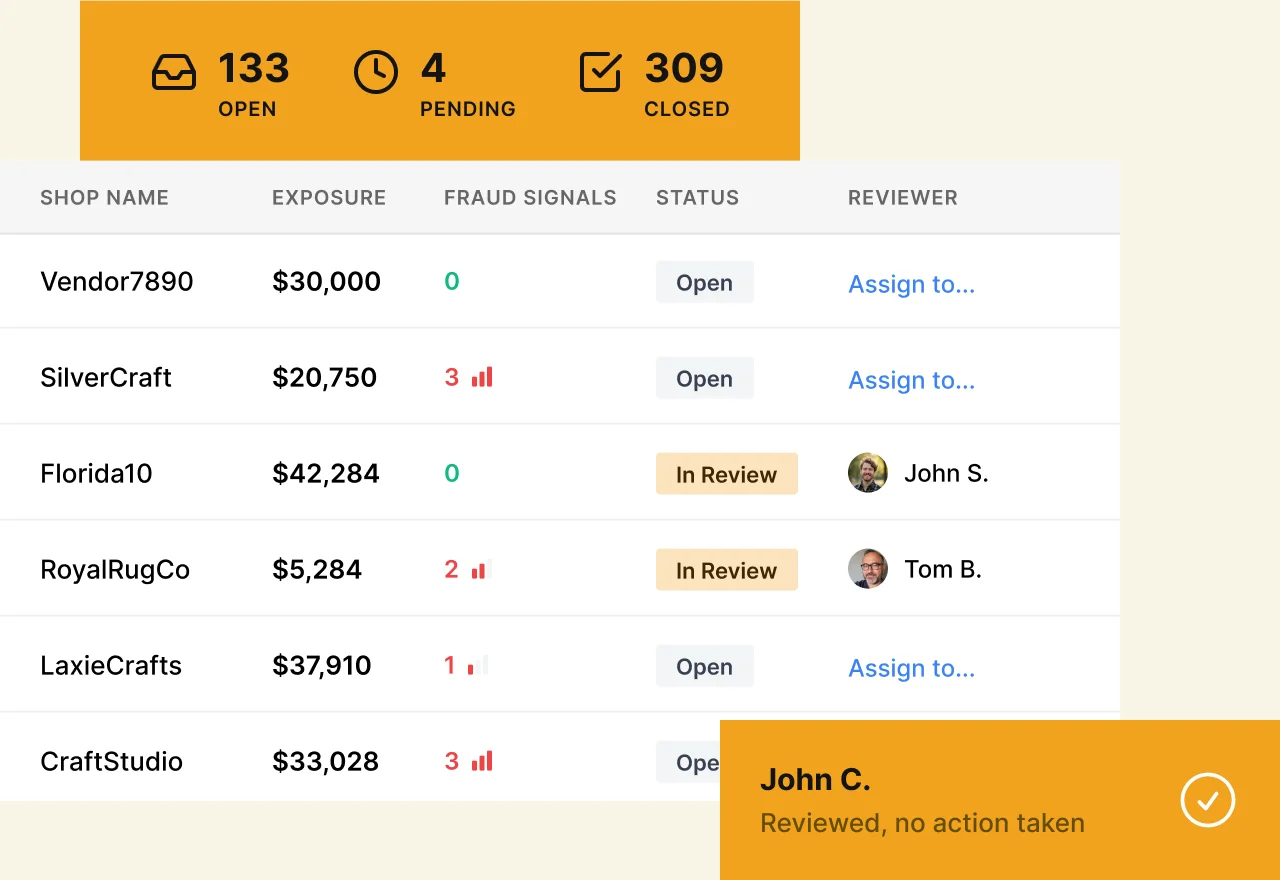

UpworkCliente clave Case management performance dashboard

Case management performance dashboard Character.ai

Character.ai Content moderation dashboard interface

Content moderation dashboard interface Discord

Discord Eventbrite

Eventbrite Faire

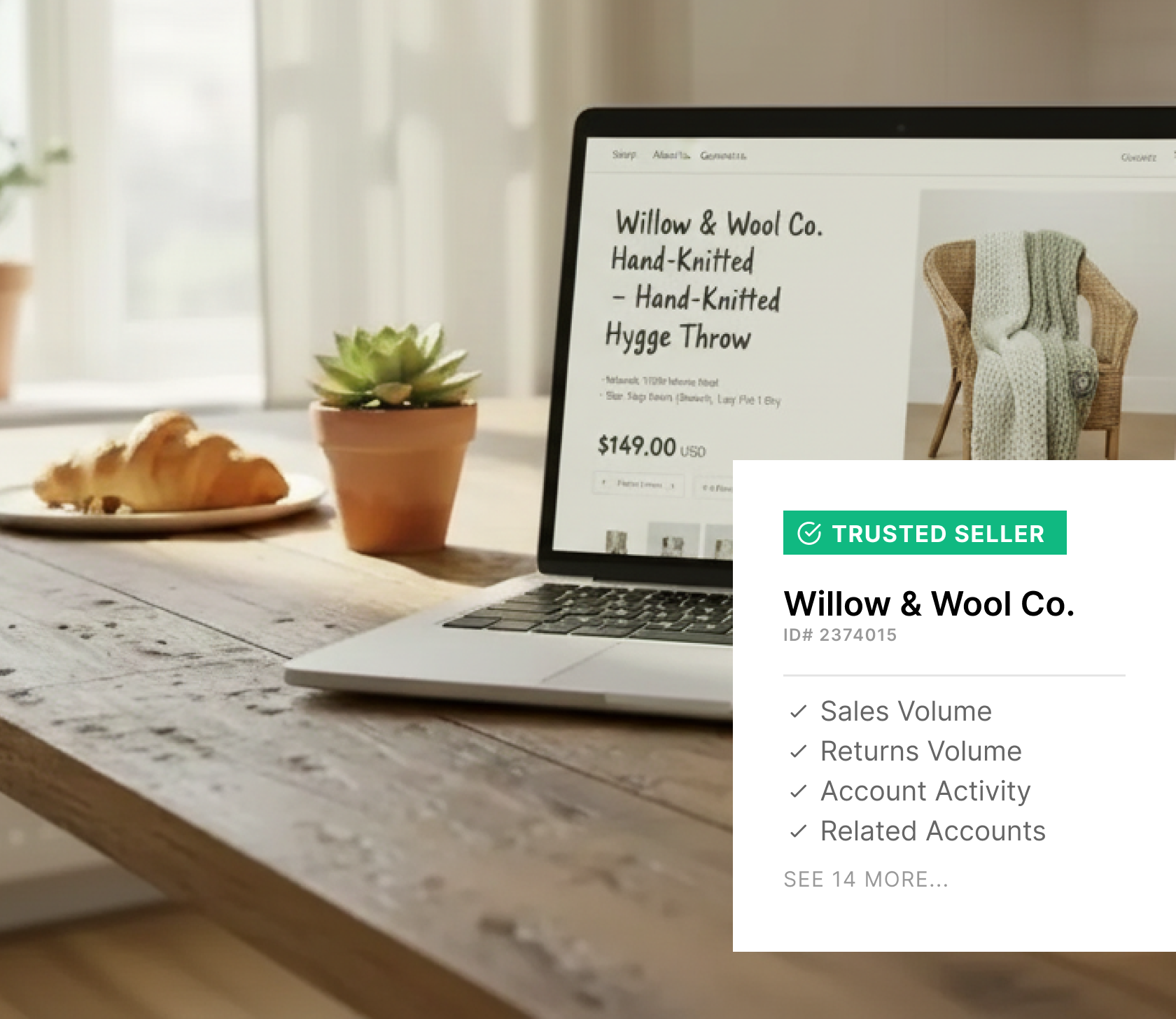

Faire Interface mockup illustrating faster risk decisions and fewer false positives

Interface mockup illustrating faster risk decisions and fewer false positives Kickstarter

Kickstarter Merchant investigations dashboard

Merchant investigations dashboard Patreon

Patreon Substack

SubstackServicios

Prevención de fraudes y gestión de riesgos

Detección de Fraudes y Riesgos

Ver detalles →Moderación de contenido y seguridad de la plataforma

Seguridad de Contenidos y Plataforma

Ver detalles →Informe de verificación de confianza de IA

Registro público de validación para SafetyKit: evidencia de legibilidad por máquina en 57 comprobaciones técnicas y 4 validaciones de visibilidad LLM.

Evidencia y enlaces

- Rastreabilidad y accesibilidad

- Datos estructurados y entidades

- Señales de calidad de contenido

- Seguridad e indicadores de confianza

Enlaces de identidad verificables

Legal y cumplimiento

- Privacy Policy

- Compliance

Identidad de terceros

- X (Twitter)

¿Estos LLM conocen este sitio web?

El “conocimiento” de un LLM no es binario. Algunas respuestas provienen de datos de entrenamiento, otras de recuperación/navegación web, y los resultados varían según el prompt, el idioma y el momento. Nuestras comprobaciones miden si el modelo puede identificar y describir correctamente el sitio para prompts relevantes.

| Plataforma LLM | Estado de reconocimiento | Comprobación de visibilidad |

|---|---|---|

| Detectado | Detectado | |

| Detectado | Detectado | |

| Parcial | Mejora la visibilidad en Gemini haciendo que las páginas principales sean fáciles de rastrear y de resumir: encabezados claros, secciones de FAQ y datos estructurados. Mantén metadatos (title/description) únicos y alineados con el contenido de la página. Construye señales de entidad coherentes en tu sitio y en perfiles de terceros de confianza. | |

| Parcial | Mejora la visibilidad en Grok manteniendo hechos de marca coherentes y señales de entidad fuertes (página About, schema de Organization, enlaces sameAs). Mantén páginas clave rápidas, rastreables y directas en sus respuestas. Actualiza regularmente páginas importantes para que los sistemas de IA tengan información fresca y fiable que citar. |

Detectado

Detectado

Mejora la visibilidad en Gemini haciendo que las páginas principales sean fáciles de rastrear y de resumir: encabezados claros, secciones de FAQ y datos estructurados. Mantén metadatos (title/description) únicos y alineados con el contenido de la página. Construye señales de entidad coherentes en tu sitio y en perfiles de terceros de confianza.

Mejora la visibilidad en Grok manteniendo hechos de marca coherentes y señales de entidad fuertes (página About, schema de Organization, enlaces sameAs). Mantén páginas clave rápidas, rastreables y directas en sus respuestas. Actualiza regularmente páginas importantes para que los sistemas de IA tengan información fresca y fiable que citar.

Nota: Los resultados del modelo pueden cambiar con el tiempo a medida que cambian los sistemas de recuperación y las instantáneas del modelo. Este informe captura señales de visibilidad en el momento del escaneo.

Qué probamos (57 comprobaciones)

Evaluamos categorías que afectan a si los sistemas de IA pueden obtener, interpretar y reutilizar información de forma segura:

Rastreabilidad y accesibilidad

12Páginas descargables, contenido indexable, cumplimiento de robots.txt, acceso de rastreadores para GPTBot, OAI-SearchBot, Google-Extended

Datos estructurados y claridad de entidad

11Marcado Schema.org, validez de JSON-LD, resolución de entidades Organization/Product, alineación con panel de conocimiento

Calidad y estructura del contenido

10Estructura de contenido respondible, consistencia factual, HTML semántico, señales E-E-A-T, presencia de datos citables

Seguridad y señales de confianza

8Aplicación de HTTPS, cabeceras seguras, presencia de política de privacidad, verificación de autor, divulgaciones de transparencia

Rendimiento y UX

9Core Web Vitals, renderizado móvil, mínima dependencia de JavaScript, señales de disponibilidad fiables

Análisis de legibilidad

7Nomenclatura clara que coincide con la intención del usuario, desambiguación frente a marcas similares, nombre consistente en las páginas

Detectadas 22 oportunidades de visibilidad de IA

Estas brechas técnicas “ocultan” a SafetyKit de los motores de búsqueda modernos y de los agentes de IA.

Top 3 bloqueadores

- !Schema de datos estructurados presenteImplementa datos estructurados donde encajen con el contenido (FAQPage, HowTo, Product, Organization, Article, BreadcrumbList). El schema da a las máquinas un mapa fiable de tu página y ayuda a extraer hechos correctamente. Prioriza el schema en tus páginas más valiosas y luego amplía a todo el sitio tras validar.

- !Schema JSON-LD: Organization, Product, FAQ, WebsiteAñade JSON-LD de schema.org para describir tus entidades clave (Organization, Product/Service, FAQPage, WebSite, Article cuando aplique). Los datos estructurados hacen explícito el significado y mejoran la probabilidad de resultados enriquecidos y citas precisas en IA. Valida el marcado con herramientas de prueba de schema y mantén los datos cohere…

- !Schema dedicado de precios/productoUsa schema de Product y Offer (o una página de precios con datos estructurados) para describir planes, precios, moneda, disponibilidad y funcionalidades clave. Esto reduce la ambigüedad tanto para buscadores como para asistentes de IA y puede habilitar fragmentos enriquecidos. Mantén los precios al día y asegúrate de que los valores del schema coin…

Top 3 mejoras rápidas

- !Etiquetas canonical usadas correctamenteUsa etiquetas canonical para definir la versión preferida de cada página, especialmente cuando existan parámetros, filtros o URLs duplicadas. Las canonical evitan confusión por contenido duplicado y consolidan señales de ranking. Verifica que las URLs canonical devuelvan estado 200 y apunten a la página correcta e indexable.

- !llms.txt rastreable por LLMCrea un archivo llms.txt para guiar a rastreadores de IA hacia tus páginas más importantes y de mayor calidad (documentación, precios, about, guías clave). Mantenlo corto, bien estructurado y enfocado en URLs autoritativas que quieras que se citen. Trátalo como un “sitemap para IA” curado que mejora el descubrimiento y reduce el riesgo de que los r…

- !¿La página tiene páginas transparentes de privacidad y términos?Publica páginas claras de Política de Privacidad y Términos, y enlázalas desde el footer. Explica recopilación de datos, cookies, derechos del usuario y cómo se gestionan las solicitudes (especialmente en regiones reguladas). Estas páginas aumentan señales de confianza y legitimidad que apoyan tanto SEO como el descubrimiento impulsado por IA.

Reclama este perfil para generar al instante el código que hace que tu negocio sea legible por máquina.

Insertar insignia

VerificadoMuestra este indicador de confianza de IA en tu sitio web. Enlaza de vuelta a esta URL pública de verificación.

<a href="https://bilarna.com/es/provider/safetykit" target="_blank" rel="nofollow noopener noreferrer" class="bilarna-trust-badge">

<img src="https://bilarna.com/badges/ai-trust-safetykit.svg"

alt="Confianza de IA verificada por Bilarna (35/57 comprobaciones)"

width="200" height="60" loading="lazy">

</a>Citar este informe

APA / MLACita lista para pegar en artículos, páginas de seguridad o documentación de cumplimiento.

Bilarna. "SafetyKit Informe de confianza de IA y visibilidad LLM." Bilarna AI Trust Index, Jan 23, 2026. https://bilarna.com/es/provider/safetykitQué significa Verificado

Verificado significa que las comprobaciones automatizadas de Bilarna encontraron suficientes señales consistentes de confianza y legibilidad por máquina como para tratar el sitio web como una fuente fiable para extracción y referencia. No es una certificación legal ni un aval; es una instantánea medible de señales públicas en el momento del escaneo.

Preguntas frecuentes

¿Qué mide la puntuación de confianza de IA para SafetyKit?

¿Qué mide la puntuación de confianza de IA para SafetyKit?

Resume la rastreabilidad, claridad, señales estructuradas e indicadores de confianza que influyen en si los sistemas de IA pueden interpretar y referenciar SafetyKit de forma fiable. La puntuación agrega 57 comprobaciones técnicas en seis categorías que afectan a cómo los LLM y los sistemas de búsqueda extraen y validan información.

¿ChatGPT/Gemini/Perplexity conocen SafetyKit?

¿ChatGPT/Gemini/Perplexity conocen SafetyKit?

A veces, pero no de forma consistente: los modelos pueden apoyarse en datos de entrenamiento, recuperación web o ambos, y los resultados varían según la consulta y el momento. Este informe mide señales observables de visibilidad y corrección en lugar de asumir un “conocimiento” permanente. Nuestras 4 comprobaciones de visibilidad LLM confirman si las principales plataformas pueden reconocer y describir correctamente SafetyKit para consultas relevantes.

¿Con qué frecuencia se actualiza este informe?

¿Con qué frecuencia se actualiza este informe?

Volvemos a escanear periódicamente y mostramos la fecha de última actualización (actualmente Jan 23, 2026) para que los equipos puedan validar la vigencia. Los escaneos automatizados se ejecutan cada dos semanas, con validación manual de visibilidad LLM mensualmente. Los cambios significativos activan actualizaciones intermedias.

¿Puedo insertar el indicador de confianza de IA en mi sitio?

¿Puedo insertar el indicador de confianza de IA en mi sitio?

Sí: utiliza el código de inserción de la insignia en la sección “Insertar insignia” arriba; enlaza a esta URL pública de verificación para que otros puedan validar el indicador. La insignia muestra el estado de verificación actual y se actualiza automáticamente cuando se renueva la verificación.

¿Esto es una certificación o un aval?

¿Esto es una certificación o un aval?

No. Es un escaneo basado en evidencias y repetible de señales públicas que afectan la interpretabilidad por IA y búsqueda. El estado “Verificado” indica señales técnicas suficientes para legibilidad por máquina, no calidad del negocio, cumplimiento legal ni eficacia del producto. Representa una instantánea de accesibilidad técnica en el momento del escaneo.

Desbloquea el informe completo de visibilidad de IA

Chatea con Bilarna AI para aclarar tus necesidades y obtener un presupuesto preciso de SafetyKit o de expertos mejor valorados al instante.