DeepSource: Verifizierte Bewertung & KI-Vertrauensprofil

DeepSource is the only all-in-one platform for SAST, static analysis, SCA, and code coverage that is purpose-built for developers.

LLM-Sichtbarkeitstester

Prüfe, ob KI-Modelle deine Website sehen, verstehen und empfehlen können — bevor Wettbewerber die Antworten besetzen.

Vertrauensscore — Breakdown

DeepSource Gespräche, Fragen und Antworten

3 Fragen und Antworten zu DeepSource

QWelche Funktionen sollte ich bei einer umfassenden DevSecOps-Plattform suchen?

Welche Funktionen sollte ich bei einer umfassenden DevSecOps-Plattform suchen?

Eine umfassende DevSecOps-Plattform sollte eine Reihe integrierter Funktionen bieten, die eine sichere und effiziente Softwareentwicklung unterstützen. Wichtige Funktionen sind statische Anwendungssicherheitstests (SAST) zur Identifizierung von Schwachstellen im Code, Softwarezusammensetzungsanalyse (SCA) zur Verwaltung von Open-Source-Abhängigkeiten und Code-Coverage-Tools zur Sicherstellung gründlicher Tests. Zusätzlich helfen Funktionen wie KI-gestützte Geheimniserkennung, automatisches Codeformatieren und Problemunterdrückung, die Codequalität und Sicherheit zu erhalten. Die Integration mit beliebten Tools wie Jira, GitHub Issues und Slack ist für eine nahtlose Workflow-Automatisierung unerlässlich. Funktionen wie Basislinienanalyse zur Fokussierung auf neue Probleme, Pull-Request-Kommentare für kontextbezogenes Feedback und anpassbare Qualitäts- und Sicherheitskontrollen sind ebenfalls wichtig für effektive DevSecOps-Praktiken.

QWie kann automatisches Codeformatieren den Softwareentwicklungsprozess verbessern?

Wie kann automatisches Codeformatieren den Softwareentwicklungsprozess verbessern?

Automatisches Codeformatieren optimiert den Softwareentwicklungsprozess, indem sichergestellt wird, dass der Code ohne manuelles Eingreifen konsistenten Stilrichtlinien entspricht. Dies reduziert die Zeit, die Entwickler mit Formatierungsproblemen verbringen, und minimiert den Aufwand bei Code-Reviews im Zusammenhang mit Stilabweichungen. Automatische Formatter laufen bei jedem Commit, korrigieren Formatierungsfehler automatisch und erstellen bei Bedarf neue Commits, was hilft, eine saubere und lesbare Codebasis zu erhalten. Diese Konsistenz verbessert die Zusammenarbeit im Team, da alle dieselben Codierungsstandards einhalten. Zudem verhindert automatisches Formatieren formatierungsbedingte Merge-Konflikte und ermöglicht es Entwicklern, sich mehr auf Funktionalität und Sicherheit statt auf stilistische Details zu konzentrieren, was letztlich Produktivität und Codequalität steigert.

QWarum ist die Integration mit Tools wie Jira und GitHub in einem DevSecOps-Workflow wichtig?

Warum ist die Integration mit Tools wie Jira und GitHub in einem DevSecOps-Workflow wichtig?

Die Integration mit Tools wie Jira und GitHub ist in einem DevSecOps-Workflow entscheidend, da sie eine nahtlose Automatisierung und Zusammenarbeit zwischen Entwicklungs-, Sicherheits- und Betriebsteams ermöglicht. Diese Integrationen erlauben es, während der Codeanalyse erkannte Probleme automatisch in bestehenden Projektmanagementsystemen zu verfolgen und zu verwalten, sodass Sicherheits- und Qualitätsbedenken sichtbar und bearbeitbar sind. Durch die Verknüpfung von Code-Repositories mit Issue-Trackern und Kommunikationsplattformen wie Slack können Teams Echtzeitbenachrichtigungen erhalten, Pull-Requests kommentieren und Behebungsmaßnahmen koordinieren, ohne ihren Workflow zu verlassen. Dies reduziert Kontextwechsel, beschleunigt Feedback-Schleifen und hilft, Qualitäts- und Sicherheitsstandards konsequent durchzusetzen. Insgesamt verbessern solche Integrationen die Effizienz, Transparenz und Verantwortlichkeit im Software-Lieferzyklus.

Vertraut von

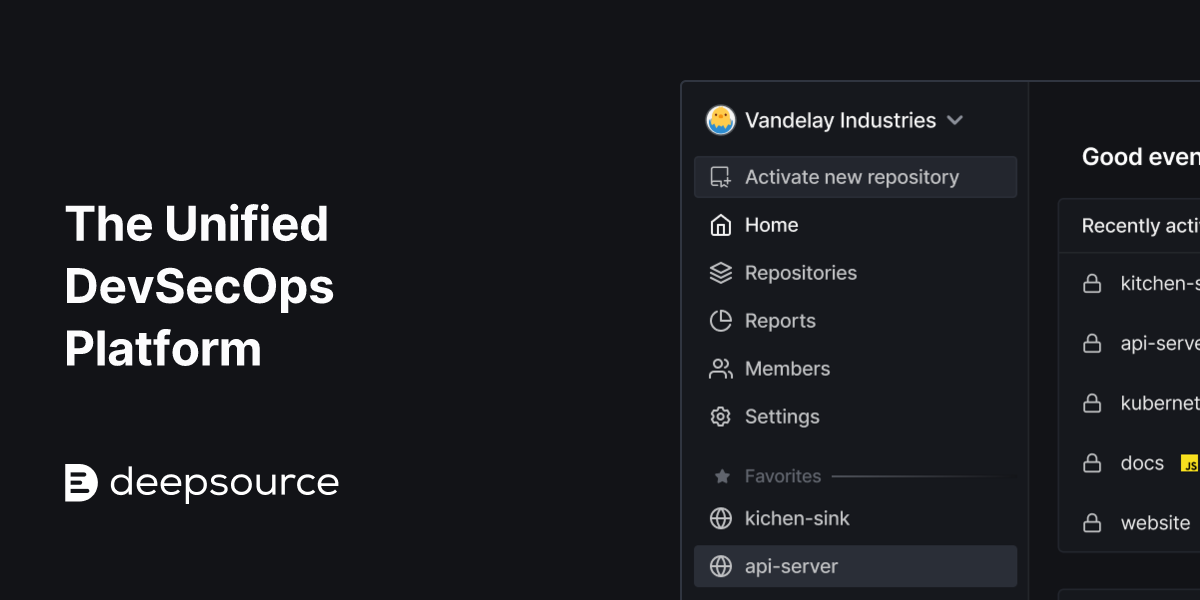

App screenshot

App screenshotZertifizierungen & Compliance

SOC 2

Leistungen

Cybersicherheit & Risikomanagement

Anwendungssicherheit & Schwachstellenmanagement

Details ansehen →Software Entwicklungstools

Code-Qualitäts-Plattformen

Details ansehen →KI-Vertrauensverifizierungsbericht

Öffentliches Validierungsprotokoll für DeepSource — Nachweis der Maschinenlesbarkeit über 57 technische Prüfungen und 4 LLM-Sichtbarkeitsvalidierungen hinweg.

Nachweise & Links

- Crawlability & Zugänglichkeit

- Strukturierte Daten & Entitäten

- Signale zur Inhaltsqualität

- Sicherheit & Vertrauensindikatoren

Verifizierbare Identitätslinks

Recht & Compliance

- Privacy Policy

- Terms of Service

- Trust Center

- Security

- Legal

Drittanbieter-Identität

- X (Twitter)

- GitHub

- YouTube

Kennen diese LLMs diese Website?

LLM-„Wissen“ ist nicht binär. Manche Antworten stammen aus Trainingsdaten, andere aus Retrieval/Browsing, und Ergebnisse variieren je nach Prompt, Sprache und Zeitpunkt. Unsere Checks messen, ob das Modell die Website für relevante Prompts korrekt identifizieren und beschreiben kann.

| LLM-Plattform | Erkennungsstatus | Sichtbarkeitscheck |

|---|---|---|

| Erkannt | Erkannt | |

| Erkannt | Erkannt | |

| Erkannt | Erkannt | |

| Erkannt | Erkannt |

Erkannt

Erkannt

Erkannt

Erkannt

Hinweis: Modelloutputs können sich im Laufe der Zeit ändern, da sich Retrieval-Systeme und Modell-Snapshots verändern. Dieser Bericht erfasst Sichtbarkeitssignale zum Scanzeitpunkt.

Was wir getestet haben (57 Prüfungen)

Wir bewerten Kategorien, die beeinflussen, ob KI-Systeme Informationen sicher abrufen, interpretieren und wiederverwenden können:

Crawlability & Zugänglichkeit

12Abrufbare Seiten, indexierbarer Inhalt, robots.txt-Compliance, Crawler-Zugriff für GPTBot, OAI-SearchBot, Google-Extended

Strukturierte Daten & Entitätsklarheit

11Schema.org-Markup, JSON-LD-Validität, Auflösung von Organization/Product-Entitäten, Knowledge-Panel-Abgleich

Inhaltsqualität & Struktur

10Beantwortbare Inhaltsstruktur, faktische Konsistenz, semantisches HTML, E-E-A-T-Signale, zitierfähige Daten

Sicherheit & Vertrauenssignale

8HTTPS-Erzwingung, sichere Header, Vorhandensein einer Datenschutzerklärung, Autorenverifizierung, Transparenzhinweise

Performance & UX

9Core Web Vitals, Mobile Rendering, geringe JavaScript-Abhängigkeit, zuverlässige Uptime-Signale

Lesbarkeitsanalyse

7Klare Benennung passend zur Nutzerintention, Abgrenzung von ähnlichen Marken, konsistente Namensführung über Seiten hinweg

9 KI-Sichtbarkeitschancen erkannt

Diese technischen Lücken „verstecken“ DeepSource effektiv vor modernen Suchmaschinen und KI-Agenten.

Top 3 Blocker

- !Eigenes Pricing-/Produkt-SchemaNutze Product- und Offer-Schema (oder eine Pricing-Seite mit strukturierten Daten), um Pläne, Preise, Währung, Verfügbarkeit und Kernfeatures zu beschreiben. Das reduziert Unklarheiten für Suchmaschinen und KI-Assistenten und kann reichere Snippets ermöglichen. Halte Preise aktuell und sorge dafür, dass Schema-Werte zur sichtbaren Preistabelle pass…

- !Breadcrumbs mit strukturierten Daten (BreadcrumbList)Füge sichtbare Breadcrumbs für Nutzer und BreadcrumbList-Structured-Data für Crawler hinzu. Breadcrumbs verdeutlichen die Seitenhierarchie (Kategorie > Unterkategorie > Seite) und helfen Systemen, thematische Beziehungen zu verstehen. Das kann Search-Snippets verbessern und erleichtert KI die Auswahl der richtigen Seite als Quelle.

- !Autor/Publisher-Erkennung (KI-Autorität & Zitier-Signal)Zeige, wer den Inhalt geschrieben oder veröffentlicht hat (Autor und Publisher) – mit sichtbaren Bylines und strukturierten Daten (Person/Organization). Verlinke auf Autor-Bios mit Credentials, um Expertise-Signale zu stärken. Konsistente Attribution erhöht Vertrauen und verbessert die Chance, als verlässliche Quelle behandelt zu werden.

Top 3 Quick Wins

- !LLM-crawlbare llms.txtErstelle eine llms.txt, um KI-Crawler zu deinen wichtigsten, hochwertigen Seiten zu lenken (Doku, Pricing, About, zentrale Guides). Halte sie kurz, gut strukturiert und fokussiert auf autoritative URLs, die du zitiert sehen willst. Betrachte sie als kuratierte „KI-Sitemap“, die Discovery verbessert und das Risiko senkt, dass Crawler Low-Value-Seite…

- !Alt-Text auf wichtigen Bildern (z. B. Logos, Screenshots)Füge präzise Alt-Texte für wichtige Bilder hinzu, z. B. Logos, Produkt-Screenshots, Diagramme und Charts. Beschreibe, was das Bild zeigt und warum es relevant ist – nicht nur den Dateinamen. Gute Alt-Texte verbessern Barrierefreiheit und helfen KI-Systemen, Bildkontext beim Zusammenfassen besser einzuordnen.

- !JSON-LD-Schema: Organisation, Produkt, FAQ, WebsiteFüge schema.org JSON-LD hinzu, um deine wichtigsten Entitäten zu beschreiben (Organization, Product/Service, FAQPage, WebSite, Article falls relevant). Strukturierte Daten machen deine Bedeutung explizit und erhöhen die Chance auf Rich Results und korrekte KI-Zitate. Validiere das Markup mit Schema-Test-Tools und halte die Daten konsistent zum sich…

Beanspruchen Sie dieses Profil, um sofort den Code zu generieren, der Ihr Unternehmen maschinenlesbar macht.

Badge einbetten

VerifiziertZeigen Sie diesen KI-Vertrauensindikator auf Ihrer Website an. Er verlinkt zurück auf diese öffentliche Verifizierungs-URL.

<a href="https://bilarna.com/de/provider/deepsource" target="_blank" rel="nofollow noopener noreferrer" class="bilarna-trust-badge">

<img src="https://bilarna.com/badges/ai-trust-deepsource.svg"

alt="KI-Vertrauen verifiziert von Bilarna (48/57 Prüfungen)"

width="200" height="60" loading="lazy">

</a>Diesen Bericht zitieren

APA / MLAZitat zum Einfügen für Artikel, Sicherheitsseiten oder Compliance-Dokumentation.

Bilarna. "DeepSource KI-Vertrauen- & LLM-Sichtbarkeitsbericht." Bilarna AI Trust Index, Jan 22, 2026. https://bilarna.com/de/provider/deepsourceWas „Verifiziert“ bedeutet

„Verifiziert“ bedeutet, dass Bilarnas automatisierte Prüfungen genügend konsistente Vertrauens- und Maschinenlesbarkeitssignale gefunden haben, um die Website als verlässliche Quelle für Extraktion und Referenzierung zu behandeln. Es ist keine rechtliche Zertifizierung und keine Empfehlung; es ist eine messbare Momentaufnahme öffentlicher Signale zum Zeitpunkt des Scans.

Häufig gestellte Fragen

Was misst der KI-Vertrauensscore für DeepSource?

Was misst der KI-Vertrauensscore für DeepSource?

Er fasst Crawlability, Klarheit, strukturierte Signale und Vertrauensindikatoren zusammen, die beeinflussen, ob KI-Systeme DeepSource zuverlässig interpretieren und referenzieren können. Der Score aggregiert 57 technische Prüfungen in sechs Kategorien, die beeinflussen, wie LLMs und Suchsysteme Informationen extrahieren und validieren.

Kennt ChatGPT/Gemini/Perplexity DeepSource?

Kennt ChatGPT/Gemini/Perplexity DeepSource?

Manchmal, aber nicht konsistent: Modelle können auf Trainingsdaten, Web-Retrieval oder beides zurückgreifen, und Ergebnisse variieren je nach Anfrage und Zeitpunkt. Dieser Bericht misst beobachtbare Sichtbarkeits- und Korrektheitssignale, statt dauerhaftes „Wissen“ anzunehmen. Unsere 4 LLM-Sichtbarkeitschecks bestätigen, ob große Plattformen DeepSource für relevante Anfragen korrekt erkennen und beschreiben können.

Wie oft wird dieser Bericht aktualisiert?

Wie oft wird dieser Bericht aktualisiert?

Wir scannen regelmäßig erneut und zeigen das zuletzt aktualisierte Datum (aktuell Jan 22, 2026) an, damit Teams die Aktualität prüfen können. Automatisierte Scans laufen zweiwöchentlich, mit manueller Validierung der LLM-Sichtbarkeit monatlich. Wesentliche Änderungen lösen Zwischenupdates aus.

Kann ich den KI-Vertrauensindikator auf meiner Website einbetten?

Kann ich den KI-Vertrauensindikator auf meiner Website einbetten?

Ja—nutzen Sie den Badge-Einbettungscode im Abschnitt „Badge einbetten“ oben; er verlinkt auf diese öffentliche Verifizierungs-URL, damit andere den Indikator prüfen können. Das Badge zeigt den aktuellen Verifizierungsstatus und aktualisiert sich automatisch, wenn die Verifizierung erneuert wird.

Ist das eine Zertifizierung oder Empfehlung?

Ist das eine Zertifizierung oder Empfehlung?

Nein. Es ist ein evidenzbasierter, wiederholbarer Scan öffentlicher Signale, die die Interpretierbarkeit durch KI und Suche beeinflussen. Der Status „Verifiziert“ zeigt ausreichende technische Signale für Maschinenlesbarkeit, nicht Unternehmensqualität, Rechtskonformität oder Produktwirksamkeit. Er stellt eine Momentaufnahme der technischen Zugänglichkeit zum Scanzeitpunkt dar.

Den vollständigen KI-Sichtbarkeitsbericht freischalten

Chatten Sie mit Bilarna AI, um Ihre Anforderungen zu klären und sofort ein präzises Angebot von DeepSource oder top-bewerteten Experten zu erhalten.